LiteRT-LM: rode LLMs no celular e Raspberry Pi — sem pagar API por token

LiteRT-LM é o framework open-source do Google para inferência de modelos de linguagem em dispositivos edge — celular Android, iPhone, computador e até Raspberry Pi — sem depender de APIs pagas na nuvem. O projeto acumula 2.329 stars no GitHub, tem 30 contribuidores ativos e chegou ao seu 17º release em 03/04/2026, há apenas quatro dias. O gatilho para o crescimento recente foi o suporte ao Gemma 4, modelo mais recente do Google, lançado com desempenho superior na categoria de modelos compactos. Para quem constrói produtos com vibe coding, isso muda o cálculo: em vez de pagar entre R$ 0,50 e R$ 5,00 por mil tokens em API, o modelo roda no hardware do próprio usuário, com custo marginal zero. Aceleração por GPU e NPU, suporte multimodal (visão e áudio) e function calling para fluxos agênticos completam o pacote.

O que faz

LiteRT-LM executa LLMs diretamente no dispositivo, sem conexão com servidores externos. O framework suporta os principais modelos abertos — Gemma (versões 1, 2, 3 e 4), Llama, Phi-4 e Qwen — e roda em Android, iOS, Web, desktop e hardware embarcado como Raspberry Pi.

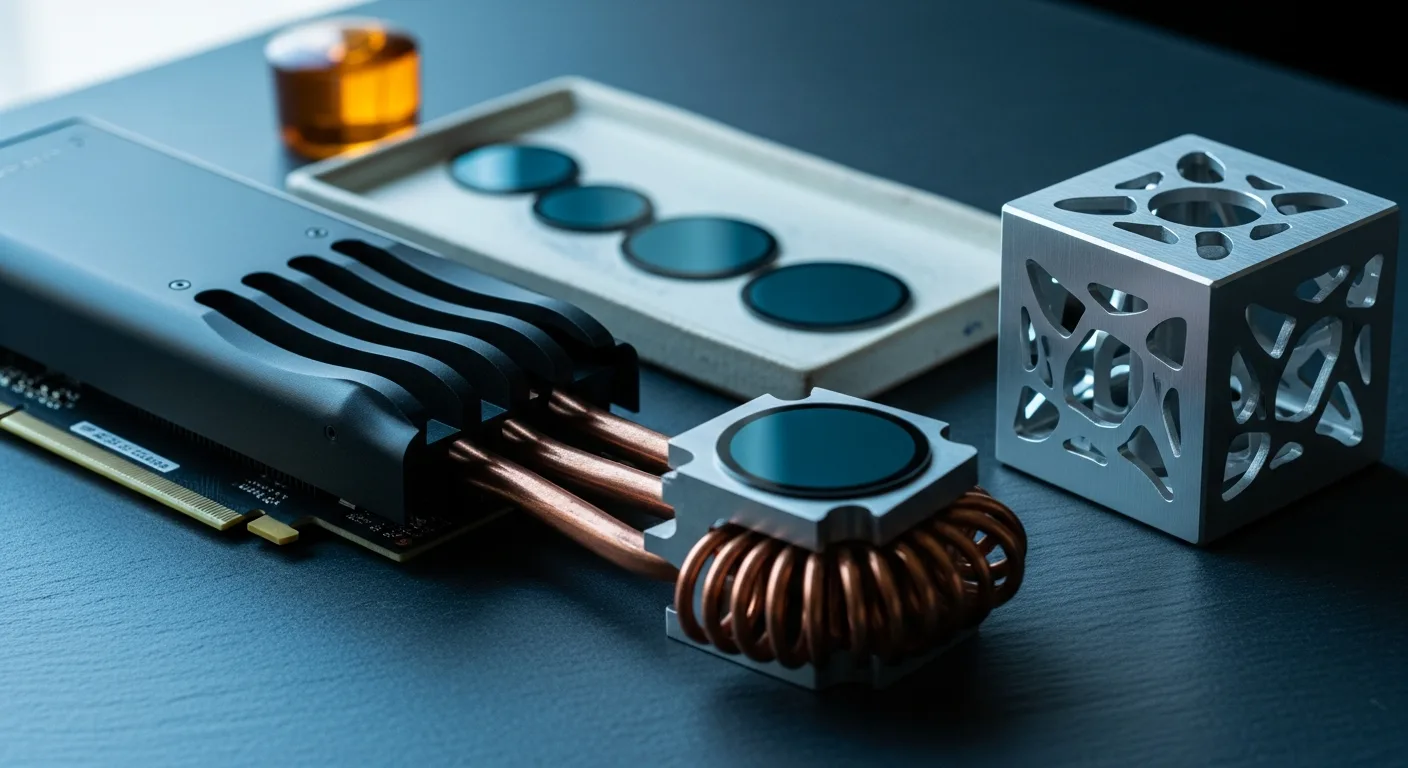

A proposta de valor é inferência local com aceleração de hardware real. O framework detecta automaticamente GPU e NPU disponíveis — chips como Qualcomm Snapdragon, Apple Silicon e MediaTek — e extrai o máximo de performance sem configuração manual.

Além de texto, o LiteRT-LM suporta entradas multimodais (imagem e áudio) e implementa function calling, o mecanismo que permite ao modelo chamar funções externas. Isso viabiliza agentes autônomos rodando inteiramente offline: um assistente de vendas no celular que funciona mesmo sem internet.

Por que está em alta

O lançamento do Gemma 4 pelo Google em abril de 2026 foi o catalisador imediato. O modelo chegou com desempenho superior aos predecessores na mesma faixa de tamanho, e o LiteRT-LM foi atualizado na mesma semana para suportá-lo — sinal de que o projeto tem prioridade alta dentro do Google.

O movimento mais amplo também explica a tração: a corrida por IA local (on-device AI) acelerou depois que Apple e Samsung passaram a incluir NPUs dedicadas em seus chips. Rodar LLMs sem API virou opção real em hardware de consumo, não só em servidores corporativos.

Para quem usa IA para automatizar processos de marketing, a equação muda: custo de inferência zero em escala, privacidade de dados garantida e funcionamento offline.

Métricas

| Métrica | Valor |

|---|---|

| Stars | 2.329 |

| Forks | 233 |

| Licença | Apache-2.0 |

| Último update | 07/04/2026 |

| Linguagem | C++ |

| Contributors | 30 |

| Releases | 17 |

| Issues abertas | 122 |

Para quem serve — e para quem não serve

Serve para:

- Desenvolvedores construindo apps mobile com IA embarcada (assistentes, busca semântica, classificação de texto offline)

- Equipes que precisam rodar modelos em hardware controlado, sem dados saindo para a nuvem — setores regulados como saúde, jurídico e financeiro

- Projetos de vibe coding onde o custo de API inviabiliza a margem — modelos de 1B a 4B parâmetros rodam bem em celulares modernos

- Automação local em Raspberry Pi para IoT com processamento de linguagem natural

Não serve para:

- Quem precisa de modelos grandes (70B+) — LiteRT-LM é otimizado para modelos compactos

- Projetos que exigem raciocínio avançado — GPT-4o e Claude Opus ainda superam modelos edge em tarefas complexas

- Times sem experiência em C++ ou integração nativa — a curva de entrada é mais alta do que consumir uma API REST

Alternativas

llama.cpp — O framework mais popular para inferência local em CPU e GPU. Suporte a mais modelos e comunidade maior (68k+ stars em abril de 2026). Mais flexível, mas sem foco em mobile nativo. Gratuito.

Ollama — Camada amigável sobre llama.cpp para desktop. Um comando para baixar e rodar modelos. Ideal para desenvolvimento local, não para distribuição em apps móveis. Gratuito.

OpenAI API / Google Gemini API — As alternativas pagas na nuvem. Máxima capacidade, zero overhead de setup, mas custo variável que escala com o uso. A partir de US$ 0,15 por milhão de tokens (modelos leves, em abril de 2026).

Veredicto

LiteRT-LM é a aposta mais séria do Google para IA em dispositivos móveis e edge. Para quem está construindo produtos onde custo de inferência ou privacidade de dados são variáveis críticas, vale investigar agora — especialmente com o suporte a Gemma 4 recém-lançado. Não é para iniciantes, mas o potencial de eliminar custo variável de API em escala é concreto.

Fonte: LiteRT-LM no GitHub

CEO @leadmarkbr · Especialista em SEO e Tráfego Pago

CEO da LeadMark desde 2012. Mais de 15 anos em Google Ads, SEO/GEO e Meta Ads. Gero +60k leads/mês para 30 mil corretores de planos de saúde em todo o Brasil. Certificado Google Ads Search. Palestrante em eventos de marketing digital.