DeepGEMM: biblioteca CUDA da DeepSeek para GEMM FP8 — 6,4k stars em alta

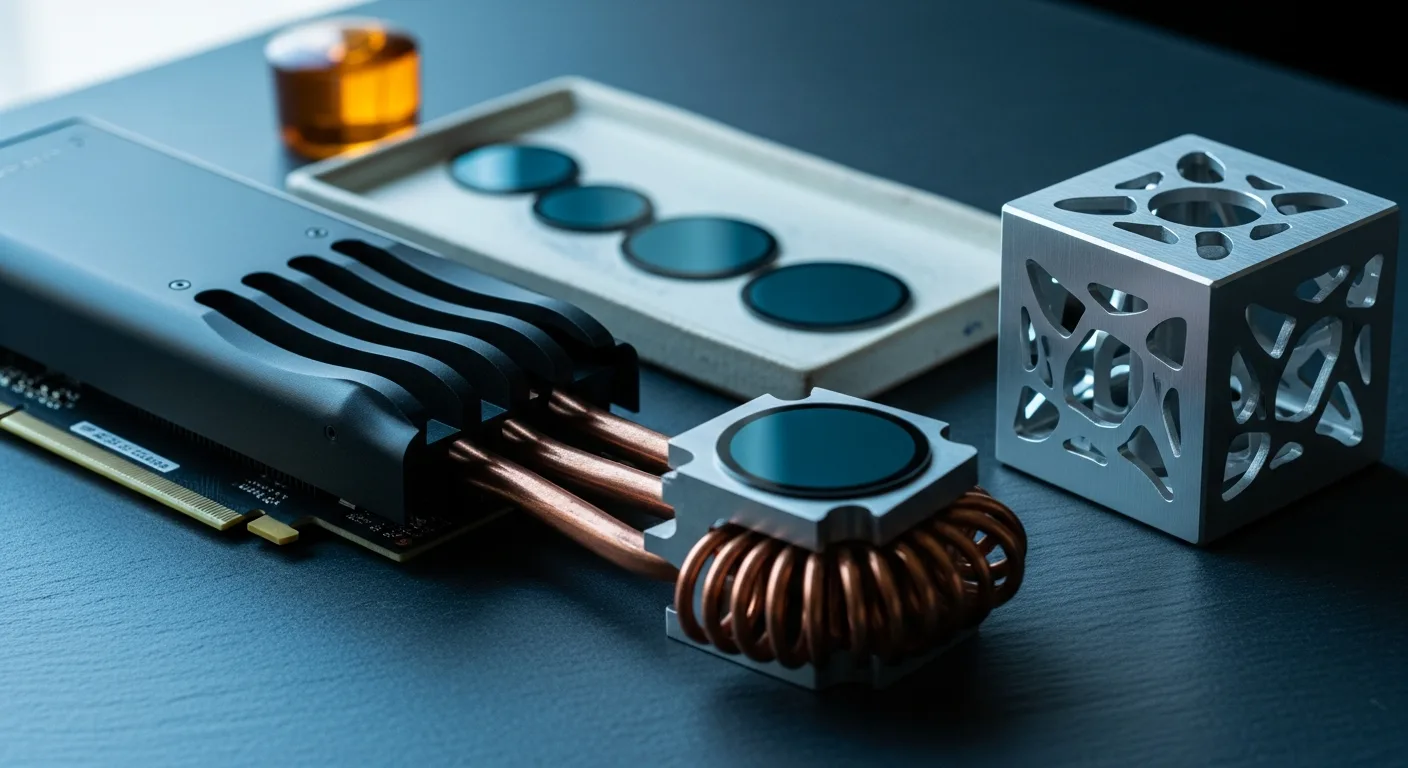

DeepGEMM é a biblioteca CUDA de alta performance da DeepSeek que unifica os kernels de computação mais críticos de LLMs modernos — GEMMs em FP8, FP4 e BF16, MoE fundido com comunicação sobreposta (Mega MoE), MQA scoring e HyperConnection — em um único codebase enxuto. Lançada como open-source com licença MIT, já acumulou 6.418 stars e 871 forks em abril de 2026, com 41 contribuidores ativos e último commit há 1 dia. O diferencial: todos os kernels são compilados em tempo de execução via JIT (Just-In-Time), sem exigir compilação CUDA na instalação. Está em alta porque a DeepSeek consolidou em uma só biblioteca o que antes exigia quatro ou cinco projetos separados do ecossistema NVIDIA. Para quem roda LLMs próprios ou treina modelos customizados, significa menos dependência de stacks pesadas como CUTLASS e mais controle sobre cada primitiva de computação.

O que faz

DeepGEMM é uma biblioteca de kernels para GPUs NVIDIA focada nas operações matemáticas mais caras em LLMs. Em termos práticos, ela acelera a multiplicação de matrizes (GEMM — General Matrix Multiplication) usando precisão reduzida FP8 e FP4 com escalonamento fino, mantendo qualidade de resultado.

Além do GEMM, entrega Mixture-of-Experts (MoE) fundido com comunicação sobreposta, scoring MQA (Multi-Query Attention) para indexação rápida e HyperConnection, um padrão de conexão entre camadas.

O projeto foi desenhado para ser simples de ler. Em vez de templates C++ densos como CUTLASS, o código aposta em funções diretas. Isso serve tanto para usar em produção quanto para estudar como kernels NVIDIA são otimizados. Para quem trabalha com vibe coding e cria software com IA, é uma referência de como organizar código complexo de forma legível.

Por que está em alta

A DeepSeek virou referência em eficiência de treinamento de modelos desde o lançamento do DeepSeek-V3. DeepGEMM é a peça que explica parte dessa eficiência — e ao liberar como open-source MIT, a empresa colocou na mesa tecnologia que competidores guardam a sete chaves.

Entre janeiro e abril de 2026, o repositório dobrou de stars. O último release foi em 05/01/2026 e o ritmo de commits permanece diário. Com 41 contribuidores e o top contributor respondendo por 56% dos commits, ainda é um projeto centralizado — mas a comunidade externa cresce.

Tabela de métricas

| Métrica | Valor |

|---|---|

| Stars | 6.418 |

| Licença | MIT |

| Último update | 1 dia atrás |

| Linguagem | CUDA |

| Contributors | 41 |

| Forks | 871 |

| Issues abertas | 62 |

Para quem serve / Para quem NÃO serve

Serve para: times de engenharia de IA que treinam ou servem LLMs próprios em GPUs NVIDIA (Hopper, Blackwell). Também para pesquisadores estudando otimização de kernels e empresas que querem reduzir custo de inferência em produção usando FP8/FP4 sem comprometer qualidade.

É ideal para quem já domina CUDA e quer substituir stacks complexas do ecossistema NVIDIA por algo mais enxuto e auditável. A licença MIT permite uso comercial sem restrições.

NÃO serve para: empreendedores que só consomem IA via API (OpenAI, Anthropic, Gemini). Se o negócio não roda modelos próprios em infraestrutura própria, DeepGEMM é complexidade desnecessária.

Também não serve para quem usa hardware que não seja NVIDIA (AMD, Apple Silicon, TPUs do Google). E não é biblioteca de aplicação — não tem API REST nem interface. É código de baixo nível que precisa ser integrado em um framework de treinamento ou inferência.

Alternativas

CUTLASS (NVIDIA, open-source) — a biblioteca oficial da NVIDIA para kernels GEMM. Mais completa, porém com curva de aprendizado maior por depender de templates C++ pesados. Gratuita.

cuBLAS (NVIDIA, proprietária) — a biblioteca padrão para álgebra linear em CUDA. Já vem com o toolkit. Boa para casos gerais, mas limitada em FP8 com escalonamento fino.

Triton (OpenAI, open-source) — DSL Python para escrever kernels GPU. Mais acessível que CUDA puro, embora menos otimizada para FP8 do que DeepGEMM. Gratuita, licença MIT.

Para quem quer entender o custo real de rodar IA em escala, vale combinar DeepGEMM com análise de como a IA otimiza operações de marketing — o mesmo princípio de reduzir custo por operação se aplica.

Veredicto

Se o negócio roda modelos próprios em GPU NVIDIA, DeepGEMM merece avaliação sério — pode cortar custos de inferência em FP8 com menos atrito que CUTLASS. Para quem só consome APIs de IA, ignore. É referência técnica, não produto de prateleira.

Fonte: DeepGEMM no GitHub

CEO @leadmarkbr · Especialista em SEO e Tráfego Pago

CEO da LeadMark desde 2012. Mais de 15 anos em Google Ads, SEO/GEO e Meta Ads. Gero +60k leads/mês para 30 mil corretores de planos de saúde em todo o Brasil. Certificado Google Ads Search. Palestrante em eventos de marketing digital.