Você já parou para pensar em como o SEO de Imagens evoluiu com a inteligência artificial? Neste artigo, vamos explorar as novas práticas que podem transformar a forma como suas imagens são vistas e indexadas.

A Inteligência Artificial e a Nova Visão do SEO de Imagens

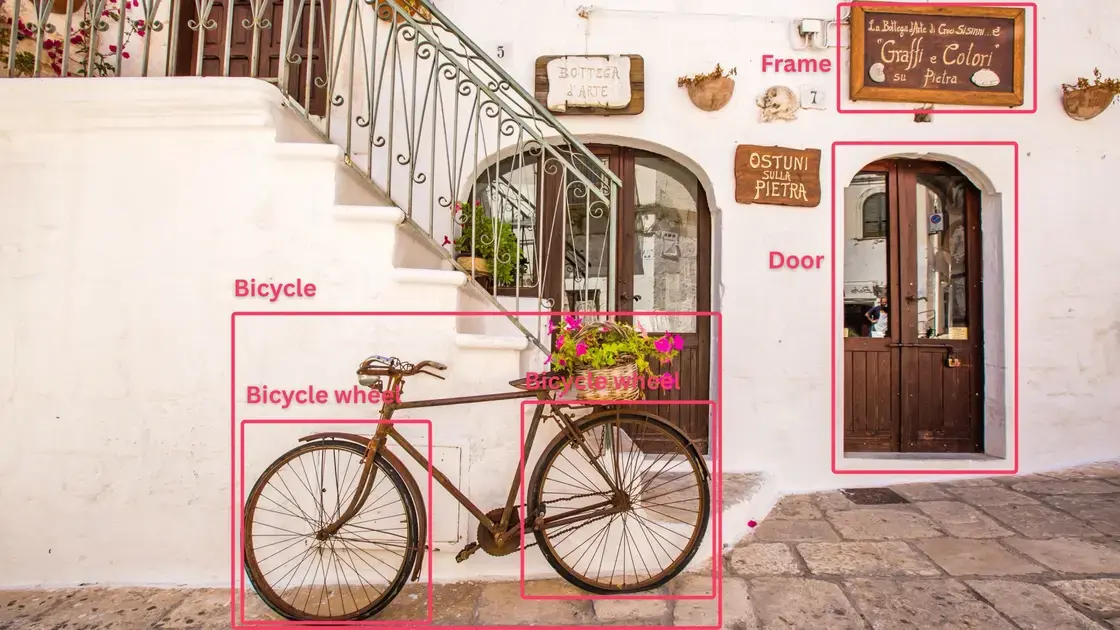

E aí, galera do digital! Se você, como eu, achava que SEO de Imagens era só sobre comprimir JPEG e colocar um alt text bonitinho, prepare-se para uma virada de jogo. Nos últimos dez anos, a gente focou muito na “higiene técnica” – sabe, pra imagem carregar rápido e não atrapalhar a experiência do usuário. E sim, isso continua sendo a base, é fundamental! Mas com a chegada de modelos multimodais gigantes, tipo o ChatGPT e o Gemini, o cenário mudou completamente. Agora, não estamos mais otimizando só para o olho humano, mas para o “olhar da máquina”. A busca multimodal, que mistura vários tipos de conteúdo, faz com que nossas imagens precisem ser “lidas” e entendidas pela inteligência artificial. É como se a IA estivesse escaneando cada pixel, extraindo texto com OCR e transformando tudo em dados. Sua imagem precisa ser legível para essa “visão” robótica.

A Nova Era do SEO de Imagens

A gente está entrando numa fase onde o SEO de imagens vai muito além do que conhecíamos. Antes, era tudo sobre otimização técnica: comprimir arquivos, usar lazy loading e escrever um bom texto alternativo para acessibilidade. Essas práticas ainda são a base, claro, mas a ascensão de modelos multimodais poderosos, como o ChatGPT e o Gemini, abriu um leque de novas possibilidades — e desafios! Agora, o foco é otimizar para o que chamamos de “olhar da máquina”. A busca generativa, que segmenta mídias em pedaços e extrai texto de elementos visuais através do OCR (Reconhecimento Óptico de Caracteres), torna a maioria do conteúdo legível para as máquinas. Isso significa que suas imagens precisam ser claras e compreensíveis para a inteligência artificial. Se a IA não consegue decifrar um texto na embalagem de um produto por causa de um contraste baixo, ou se ela “alucina” detalhes por conta de uma resolução ruim, temos um problema sério. O jogo mudou: agora, a legibilidade para a máquina é a chave.

Importância da Legibilidade para Máquinas

Pensa comigo: se a inteligência artificial não consegue “ler” o texto na embalagem de um produto por causa de um contraste ruim, ou se ela “alucina” detalhes por conta de uma resolução baixa, temos um problemão! A gente precisa ir além da velocidade de carregamento – que, claro, ainda é super importante. Imagens são uma faca de dois gumes: elas prendem a atenção, mas também podem deixar o site lento. O padrão de “bom o suficiente” já passou do WebP, viu? Agora, o verdadeiro trabalho começa depois que a imagem carrega. Para os modelos de linguagem grandes (LLMs), imagens, áudios e vídeos são como fontes de dados estruturados. Eles usam um processo chamado “tokenização visual”, que quebra a imagem em pedacinhos, ou “tokens visuais”, transformando pixels brutos em uma sequência de vetores. É assim que a IA consegue entender uma frase como “uma foto de um [token da imagem] em uma mesa”. Esses sistemas dependem do OCR para extrair texto direto das imagens. E é aqui que a qualidade vira um fator de ranqueamento. Se a imagem está muito comprimida, com aqueles artefatos de perda de qualidade, os tokens visuais ficam “sujos”. Uma resolução ruim pode fazer o modelo interpretar errado, levando a “alucinações” – a IA descreve coisas que não existem, porque as “palavras visuais” estavam confusas.

O Papel do Texto Alternativo

Para os modelos de linguagem grandes, o texto alternativo (alt text) ganhou uma função nova e super importante: ele serve como um “aterramento” semântico. Pense nele como uma placa de sinalização que força o modelo a resolver qualquer ambiguidade visual, ajudando a confirmar a interpretação que a IA faz da imagem. Como Zhang, Zhu e Tambe observaram, ao inserir tokens de texto perto de partes visuais relevantes, criamos esses “sinalizadores semânticos” que guiam o modelo. A dica de ouro aqui é descrever os aspectos físicos da imagem – a iluminação, o layout e qualquer texto presente no objeto. Assim, você fornece dados de treinamento de alta qualidade que ajudam a “visão da máquina” a correlacionar os tokens visuais com os tokens de texto de forma mais precisa.

Desafios da Leitura de Imagens

Agentes de busca como o Google Lens e o Gemini usam o OCR para ler ingredientes, instruções e características diretamente das imagens. Isso permite que eles respondam a perguntas complexas dos usuários. Por isso, o SEO de imagens agora se estende até a embalagem física dos produtos! As regulamentações atuais, como a FDA 21 CFR 101.2 e a EU 1169/2011, permitem tamanhos de fonte bem pequenos, de 4.5 pt a 6 pt, ou 0.9 mm, em embalagens compactas. Embora isso seja suficiente para o olho humano, a “visão da máquina” tem dificuldades. A resolução mínima de pixel para que o texto seja legível por OCR é bem maior: a altura do caractere deve ter pelo menos 30 pixels, e o contraste precisa atingir 40 valores de escala de cinza. Cuidado com fontes estilizadas, que podem confundir os sistemas de OCR, fazendo-os trocar um “l” minúsculo por um “1” ou um “b” por um “8”. Além do contraste, acabamentos reflexivos criam problemas adicionais. Embalagens brilhantes refletem a luz, gerando brilho que obscurece o texto. A embalagem deve ser pensada como um recurso de legibilidade para a máquina. Se a IA não consegue analisar a foto de uma embalagem por causa do brilho ou de uma fonte cursiva, ela pode “alucinar” informações ou, pior, ignorar o produto completamente.

A Originalidade como Sinal de Qualidade

A originalidade, que parece ser algo tão subjetivo e criativo, pode ser quantificada como um dado mensurável. Imagens originais funcionam como um sinal canônico. A API Google Cloud Vision tem um recurso chamado WebDetection, que retorna listas de fullMatchingImages (duplicatas exatas encontradas na web) e pagesWithMatchingImages. Se sua URL tem a data de indexação mais antiga para um conjunto único de tokens visuais (por exemplo, um ângulo específico de um produto), o Google credita sua página como a origem dessa informação visual, aumentando sua pontuação de “experiência”. É como se o Google dissesse: “Essa imagem veio daqui primeiro, então esse site tem mais autoridade sobre o assunto.”

Como Avaliar a Emoção nas Imagens

Além de identificar objetos, os modelos de IA estão cada vez mais espertos em “ler” sentimentos. APIs como a Google Cloud Vision conseguem quantificar atributos emocionais, atribuindo pontuações de confiança para emoções como “alegria”, “tristeza” e “surpresa” detectadas em rostos humanos. Isso abre um novo caminho de otimização: o alinhamento emocional. Se você está vendendo roupas de verão divertidas, mas os modelos nas fotos parecem mal-humorados ou neutros – um clichê na fotografia de alta moda –, a IA pode despriorizar sua imagem para aquela busca, porque o sentimento visual entra em conflito com a intenção de pesquisa. Para uma verificação rápida, sem precisar de código, use a demonstração interativa de arrastar e soltar do Google Cloud Vision para analisar as quatro emoções principais: alegria, tristeza, raiva e surpresa. Para intenções positivas, como “jantar feliz em família”, você quer que o atributo “alegria” registre como VERY_LIKELY. Se aparecer como POSSIBLE ou UNLIKELY, o sinal é muito fraco para a máquina indexar a imagem como “feliz” com confiança. Para uma auditoria mais detalhada, você pode rodar um lote de imagens pela API, focando no objeto faceAnnotations na resposta JSON, enviando uma solicitação de recurso FACE_DETECTION. Revise os campos de probabilidade (likelihood). A API retorna esses valores como categorias fixas. Por exemplo, você pode ver “joyLikelihood”: “VERY_LIKELY”. A API classifica a emoção em uma escala fixa, e o objetivo é mover as imagens principais de POSSIBLE para LIKELY ou VERY_LIKELY para a emoção desejada. É importante notar que se o detectionConfidence estiver abaixo de 0.60, a IA está com dificuldade para identificar um rosto, e qualquer leitura emocional ligada a ele será estatisticamente não confiável. O ideal é 0.90+ para imagens de alta definição e bem iluminadas, enquanto 0.70-0.89 é aceitável para rostos em segundo plano. Abaixo de 0.60, a imagem falha, pois o rosto provavelmente está muito pequeno, borrado ou bloqueado. A documentação da Amazon Rekognition, por exemplo, sugere que um limite mais baixo (como 80%) pode ser suficiente para identificar membros da família em fotos. No fim das contas, trate seus recursos visuais com o mesmo rigor editorial e intenção estratégica que você dá ao seu conteúdo principal. A lacuna semântica entre imagem e texto está desaparecendo, e as imagens são processadas como parte da sequência de linguagem. A qualidade, clareza e precisão semântica dos próprios pixels agora importam tanto quanto as palavras na página.

Givanildo Albuquerque